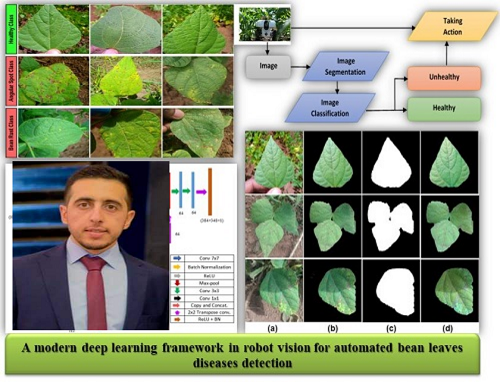

Un cadre moderne d'apprentissage profond en vision robotique pour la détection automatisée des maladies des feuilles de haricot.

2021-07-02

Sudad H. Abed, Alaa S. Al-Waisy, Hussam J. Mohammed & Shumoos Al-Fahdawi

L'agriculture est considérée comme l'une des ressources économiques les plus importantes pour les agriculteurs et les pays. Les haricots sont l'une des cultures agricoles essentielles qui fournissent des fibres alimentaires comme deuxième source significative et la troisième source importante de calories pour les êtres humains. Les feuilles de haricot peuvent être affectées par plusieurs maladies, telles que les taches angulaires et la rouille des haricots, qui peuvent causer de gros dommages aux cultures de haricots et diminuer leur productivité.

Ainsi, traiter ces maladies à leurs débuts peut améliorer la qualité et la quantité du produit. Un diagnostic incorrect de la feuille infectée peut conduire à l'utilisation de traitements chimiques pour une feuille normale, ce qui ne résoudra pas le problème, et le processus peut être coûteux et nuisible. Pour surmonter ces problèmes, un cadre moderne d'apprentissage profond dans la vision robotique pour la détection précoce des maladies des feuilles de haricot est proposé.

Le cadre proposé est composé de deux étapes principales, qui détectent les feuilles de haricot dans les images d'entrée et diagnostiquent les maladies au sein des feuilles détectées. L'architecture U-Net basée sur un encodeur ResNet34 pré-entraîné est utilisée pour détecter les feuilles de haricot dans les images d'entrée capturées dans des conditions environnementales non contrôlées.

Dans la phase de classification, la performance de cinq modèles d'apprentissage profond divers (par exemple, Densenet121, ResNet34, ResNet50, VGG-16 et VGG-19) est évaluée avec précision pour identifier la santé des feuilles de haricot. La performance du cadre proposé est évaluée à l'aide d'un ensemble de données difficile et étendu composé de 1295 images de trois classes différentes (par exemple, Sain, Tache Angulaire, et Rouille des Haricots). Dans la tâche de classification binaire, la meilleure performance est atteinte en utilisant le modèle Densenet121 avec un CAR de 98,31 %, une Sensibilité de 99,03 %, une Spécificité de 96,82 %, une Précision de 98,45 %, un F1-Score de 98,74 % et un AUC de 100 %. Un CAR plus élevé de 91,01 % est obtenu en utilisant le même modèle dans la tâche de classification multi-classes, avec moins de 2 s par image pour produire la décision finale.